Файл robots.txt — простой текстовый документ, который управляет тем, что поисковые роботы видят на сайте. Неправильная настройка способна скрыть важные страницы от выдачи или, наоборот, открыть то, что лучше держать в тени. В этой статье я пошагово расскажу, как правильно формировать файл, какие директивы использовать и как избегать типичных промахов, с которыми сталкивался сам при работе с сайтами разного размера.

Зачем нужен robots.txt и как он влияет на индексацию

Robots.txt служит первым контактом между сайтом и поисковыми ботами: при заходе на домен робот сначала запрашивает этот файл и затем решает, к каким разделам переходить. Правильные запреты помогают сэкономить бюджет обхода и предотвратить попадание в индекс служебных страниц. Неправильный запрет может лишить сайт трафика — это самая частая критическая ошибка.

Важно понимать: robots.txt не заменяет мета-тег robots и не является инструментом для защиты конфиденциальных данных. Если нужно скрыть информацию от всех, используют запреты на уровне сервера или аутентификацию. Для SEO robots.txt больше про управление обходом и приоритетами индексации.

Основы синтаксиса: что может и чего не может robots.txt

Файл robots.txt читается сверху вниз; поисковики находят первую подходящую директиву для конкретного user-agent и применяют её. Стандарт прост: указываются блоки вида User-agent и последующие директивы Disallow или Allow. Каждая строка — отдельное правило, комментарии начинаются с символа #.

Не все поисковые системы одинаково поддерживают расширенные конструкции, поэтому стоит опираться на общепринятые директивы и тестировать изменения. Ниже приведена краткая таблица с базовыми директивами и их назначением.

| Директива | Назначение |

|---|---|

| User-agent | Указывает, к каким роботам применяется блок |

| Disallow | Запрещает обход указанных путей |

| Allow | Разрешает конкретные пути, даже если ранее указан запрет |

| Sitemap | Указывает расположение карты сайта |

| Crawl-delay | Рекомендует паузу между запросами бота |

Формат строк и пути

Пути в Disallow и Allow указываются относительно корня сайта и чувствительны к регистру. Если прописать Disallow: /private, то /Private и /private/file.html считаются разными путями. Это важно при работе с ОС, где регистр сохраняется, например на Linux.

Дополнительные символы вроде * и $ поддерживаются не всеми роботами одинаково. Google и Bing понимают шаблоны с *, но лучше проверять совместимость, если целитесь на менее популярные поисковые системы.

Типичные ошибки, которые приводят к потерям трафика

На практике самые опасные ошибки — это случайные запреты корня сайта или важных разделов. Мне приходилось восстанавливать сайты, у которых в корне стоял Disallow: / — в результате поисковые системы остановили индексацию и трафик упал в разы. Всегда проверяйте файл перед публикацией.

Ещё одна частая оплошность — блокировка CSS и JavaScript. Современные поисковики рендерят страницы как браузеры, и если они не могут загрузить стили или скрипты, то неправильно определят содержание страницы. В результате снижения ранжирования можно не заметить сразу.

Ошибка: одинаковый robots.txt для продакшена и тестовой среды

Часто забывают, что черновая версия сайта не должна индексироваться, и на время разработки ставят запрет для всех роботов. Потом при деплое забывают вернуть файл, и индексирование так и не начинается. Я однажды потерял недели на поисковую видимость, пока коллега не заметил запрет в robots.txt на продакшене.

Решение простое: автоматизировать замену файла при деплое и держать шаблон для каждой среды в репозитории. Это исключает человеческий фактор и упрощает аудит.

Примеры корректных конфигураций

Ниже несколько практических примеров приложений robots.txt для типичных задач: открыт сайт для всех, закрыты админ-панели, указана карта сайта. Эти шаблоны пригодятся как отправная точка, но их нужно адаптировать под структуру конкретного проекта.

Простой открытый сайт

Если сайт публичный и нет служебных разделов, достаточно минимального файла, который разрешает обход всем ботам и указывает карту сайта. Такой файл не ограничивает индексацию и помогает поисковикам быстрее найти sitemap.xml.

Пример:

User-agent: *

Sitemap: https://example.com/sitemap.xml

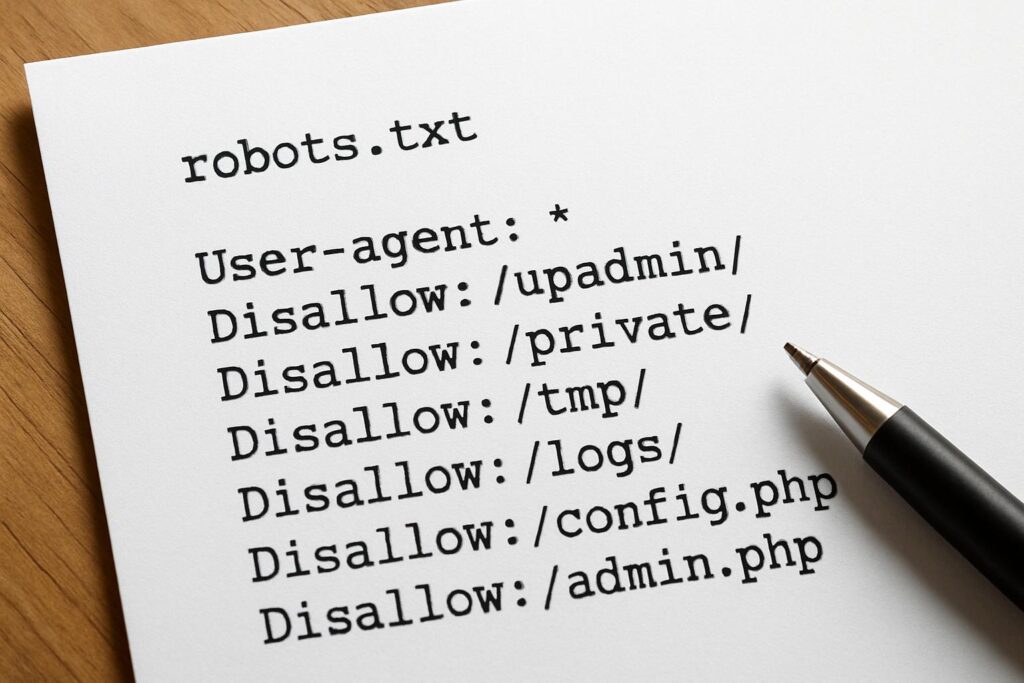

Сайт с закрытой админкой и служебными папками

Для сайтов с панелями управления и временными папками удобно явно запретить доступ к этим директориям. Одновременно важно не блокировать ресурсы, от которых зависит отображение страниц.

Пример:

User-agent: *

Disallow: /admin/

Disallow: /tmp/

Allow: /wp-content/uploads/

Sitemap: https://example.com/sitemap.xml

Работа с поисковыми системами: особенности Google и других

Google поддерживает расширенные шаблоны и директиву Sitemap, а также отображает статус файла в Search Console. Bing также читает robots.txt, но некоторые мелкие поисковики могут игнорировать нестандартные конструкции. Учитывайте это при использовании сложных правил.

Для Google важно, чтобы robots.txt был доступен по адресу https://example.com/robots.txt и возвращал код 200. Ошибки сервера или 404 приведут к тому, что робот посчитает файл отсутствующим и обработает сайт как обычно, что не всегда ожидаемо.

Использование Google Search Console

Search Console позволяет проверить содержимое robots.txt и протестировать поведение для определённых URL. Это ключевой инструмент для отладки: там видно, какие запросы блокируются и почему. Регулярно загружайте обновлённый файл и проверяйте отчёты об ошибках сканирования.

Кроме того, в консоли можно отправить запрос на повторное сканирование после изменения robots.txt, что ускорит применение новых правил.

Advanced: шаблоны, wildcard и регулярные выражения

Шаблоны с * и $ позволяют гибко управлять обходом: например, блокировать все URL, содержащие определённый параметр, или запрещать индексацию конкретных типов файлов. Google и некоторые другие роботы корректно интерпретируют такие шаблоны, но не все поисковые сети их поддерживают.

Используйте шаблоны осторожно: излишняя сложность затрудняет дальнейшее сопровождение и увеличивает риск ошибочной блокировки. Документируйте каждое правило в комментариях, чтобы через месяц понять, зачем оно появилось.

Примеры шаблонов

Блокировать все URL с параметром session:

Disallow: /*?session=

Запретить все PDF-файлы в каталоге /docs:

Disallow: /docs/*.pdf

Часто забываемые моменты: код ответа, кеширование и доступность

Если robots.txt возвращает код 5xx или 404, роботы могут считать, что файл отсутствует, и применять свои политики. Это чревато как избыточным сканированием, так и непредвиденной индексацией. Настройте мониторинг доступности файла.

Также учитывайте, что CDN и кеши могут задерживать обновления. После изменения файла убедитесь, что новая версия реально отдаётся с края сети и не затирается старым кешем.

Проверка и мониторинг

Автоматические проверки раз в сутки помогут заметить проблемные изменения. Простая задача: настроить скрипт, который запрашивает robots.txt и валидирует важные строки. Это быстро ловит случайные деплои с неверным файлом.

Я использую в проектах простые cron-задания с curl и сравнение хешей; если файл отличается, отправляется уведомление команде. Такой подход несколько раз спасал от длительной потери видимости.

robots.txt и карты сайта: как правильно связать

Добавление строки Sitemap в robots.txt — удобный способ сообщить поисковикам о расположении карты сайта, особенно если карта генерируется динамически или располагается в нестандартном месте. Поисковые системы обычно индексируют указанные ссылки быстрее.

Можно указывать несколько карт сайта, если они разделены по типам контента или по языкам. Главное — следить, чтобы все перечисленные URL были доступны и корректно возвращали XML.

Пример указания нескольких Sitemap

Sitemap: https://example.com/sitemap-pages.xml

Sitemap: https://example.com/sitemap-products.xml

Sitemap: https://example.com/sitemap-news.xml

robots.txt для мультидоменных и международных проектов

Если сайт работает на нескольких доменах или субдоменах, файл robots.txt применяется отдельно к каждому хосту. Нельзя управлять субдоменами из одного файла на основном домене. Это важно учитывать при настройке мультидоменных решений.

Для международных сайтов избегайте блокировок, которые мешают поисковым системам правильно определять hreflang и региональную релевантность. Неправильно закрытые языковые версии снизят видимость в отдельных регионах.

Советы для сайтов с переводами

Для каждой языковой версии держите свою карту сайта и свой robots.txt. В robots.txt указывайте соответствующую карту и не блокируйте директории с языковыми подкаталогами. Это упрощает управление и снижает риск случайного блокирования.

При использовании hreflang лучше обеспечить полный доступ роботам, чтобы они корректно сопоставили языковые версии и распределили трафик по регионам.

Как работать с динамическим сайтом и параметрами URL

Динамические URL с множеством параметров часто генерируют дублированный контент и нагружают бюджет обхода. robots.txt помогает сократить обход ненужных параметров, но он не решит проблему дублей. Для этого используют канонические теги и параметризацию в Search Console.

Если полностью запрещать индексацию динамических страниц через robots.txt, поисковик всё равно может индексировать ссылки на эти страницы, если они видны с других сайтов. Лучше комбинировать запреты с мета-robots noindex там, где нужно полностью исключить страницу из индекса.

Практический пример: пагинация и сортировки

Для страниц с постраничной навигацией стоит разрешать роботам обход основных страниц и запрещать индексацию вариантов с сортировками, которые не несут уникальной ценности. Использование rel=»next» и rel=»prev» помогает поисковикам понимать структуру пагинации.

Также имеет смысл указывать канонический URL на главную версию списка, чтобы не распылять вес по множественным вариантам.

Рекомендации по безопасности и защите данных

Robots.txt не является средством защиты информации. Любой пользователь может открыть файл и узнать, какие разделы вы пытались скрыть. Поэтому не стоит указывать пути к чувствительным данным в robots.txt — это лишь подсказка для злоумышленников.

Для защиты используйте серверные методы: правила на уровне веб-сервера, .htaccess, аутентификацию, ограничение по IP или шифрование. Robots.txt только упорядочивает обход, но не закрывает доступ.

Проверка после изменений: тесты и инструменты

После любых правок обязательно тестируйте файл в Google Search Console и локально с curl. Инструменты показывают, какие URL запрещены и как Google трактует правила. Это избавляет от сюрпризов и даёт уверенность, что ключевые страницы доступны.

Дополнительно стоит проверить сайт с помощью сканеров, которые имитируют поведение поисковых роботов: так можно увидеть, не блокируются ли ресурсы, необходимые для рендеринга. Это особенно актуально для SPA и сайтов на JavaScript.

Полезные инструменты

- Google Search Console — тестирование файла и мониторинг ошибок.

- Bing Webmaster Tools — аналогичные проверки для Bing.

- curl и wget — быстрые локальные проверки ответа сервера.

- Онлайн-валидаторы robots.txt — позволяют найти синтаксические ошибки.

Чек‑лист: минимальный набор правил перед публикацией

Перед размещением файла выполните ряд простых проверок, чтобы не допустить критических ошибок. Этот чек‑лист поможет систематизировать контроль и избежать типичных просчётов, которые я видел в нескольких проектах.

- Проверьте, что robots.txt доступен по адресу домена и возвращает код 200.

- Убедитесь, что корень сайта и важные разделы не запрещены случайно.

- Проверьте, что CSS и JS не блокируются, если сайт рендерится на клиенте.

- Добавьте строку Sitemap, если карта сайта существует.

- Просмотрите файл с точки зрения регистрозависимости путей.

- Тестируйте изменения в Search Console и отправляйте запрос на переобход.

Восстановление после ошибок: шаги при критической блокировке

Если вдруг обнаружите, что важные разделы были закрыты, действуйте быстро: исправьте robots.txt, убедитесь в доставке новой версии через CDN и отправьте запрос на переобход в Search Console. Также проверьте логи сервера, чтобы понять, когда и по какой причине произошла ошибка.

В моём случае для одного интернет-магазина проблема с файлом появилась из-за автоматического билда, который заменял файл шаблоном для тестовой среды. Мы исправили файл, запросили повторное сканирование и за несколько дней восстановили большую часть трафика. Быстрая реакция и прозрачная коммуникация с командой — ключ.

Лучшие практики: свод правил для долгосрочного управления

Поддерживайте файл в системе контроля версий, документируйте изменения и внедрите автоматизированные проверки при деплое. Эти простые меры резко снижают вероятность человеческой ошибки и упрощают расследование в случае проблем.

Регулярно просматривайте отчёты о сканировании и обновляйте правила, когда структура сайта меняется. Поддержание актуального robots.txt — часть технического ухода за сайтом, который приносит дивиденды в виде стабильной видимости.

Короткий набор рекомендаций

- Храните шаблоны для разных сред (prod, staging) и применяйте их автоматически.

- Ограничивайте правила: чем проще — тем надежнее.

- Не используйте robots.txt для сокрытия конфиденциальных данных.

- Всегда указывайте Sitemap, если он есть.

Мой опыт: ошибки, которые я сделал и выводы

На одном из проектов я случайно включил Disallow: / в сборке, и это обошлось падением трафика на 60% за пару недель. Мы быстро увидели проблему в логах и Search Console, но откат занял время. С тех пор я не публикую изменения без проверки хеша файла и автоматического теста в CI.

Ещё одна история: закрытие папки с картинками думалось мелочью, но это повлияло на визуальные сниппеты и даже на отображение карточек товаров в Google Shopping. Небольшая невнимательность — крупные последствия. Эти случаи научили меня один простому правилу: проверяй доступность ключевых ресурсов после каждого изменения.

Короткая шпаргалка: примеры безопасных строк

Вот несколько строк, которые чаще всего нужны в рабочем файле и не наносят вреда при разумном использовании. Они пригодятся как стартовый набор в большинстве проектов.

User-agent: *

Disallow:

Allow: /wp-content/uploads/

Sitemap: https://example.com/sitemap.xml

Что делать, если вы не уверены — минимальный безопасный файл

Когда сомневаетесь, лучше оставить файл максимально открытым и скорректировать индексацию с помощью meta-robots и rel=»canonical» на конкретных страницах. Это безопаснее, чем рисковать потерей видимости целых разделов.

Минимальный безопасный файл — это просто уведомление о карте сайта и отсутствие запретов. Такой подход минимизирует негативные последствия и даёт время для продуманной настройки.

Теперь у вас есть последовательный план действий: от понимания синтаксиса до проверки в инструментах поисковых систем и восстановления после ошибок. Правильная настройка robots.txt — это не разовая задача, а часть постоянного технического сопровождения сайта. Если будете следовать базовым правилам, документировать изменения и регулярно тестировать — риск критичных ошибок сведётся к минимуму.